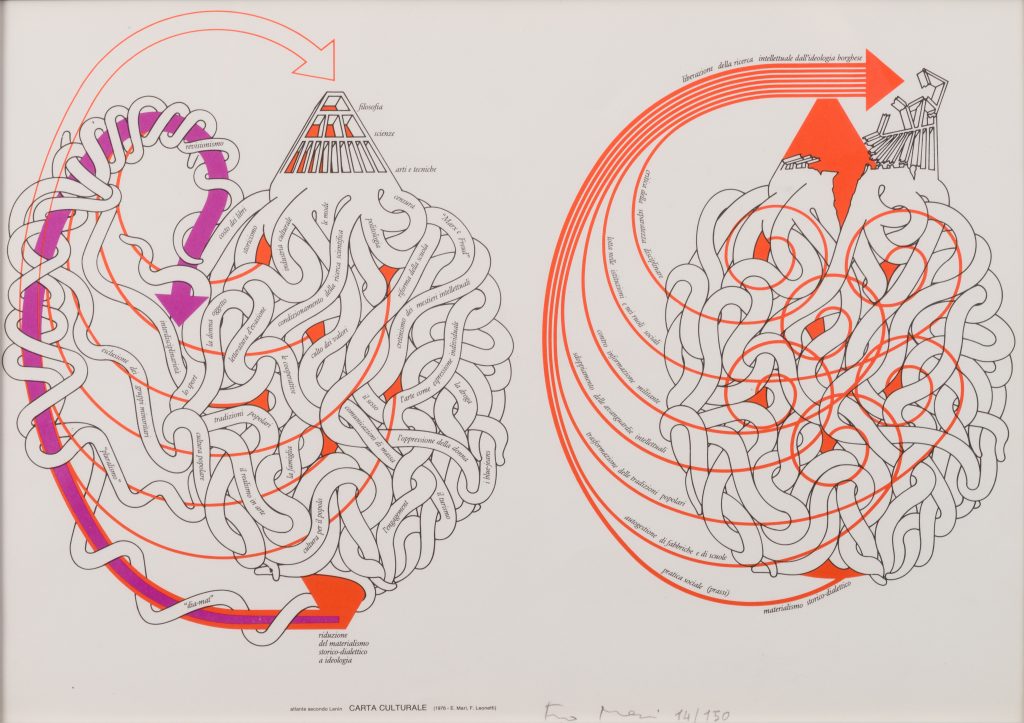

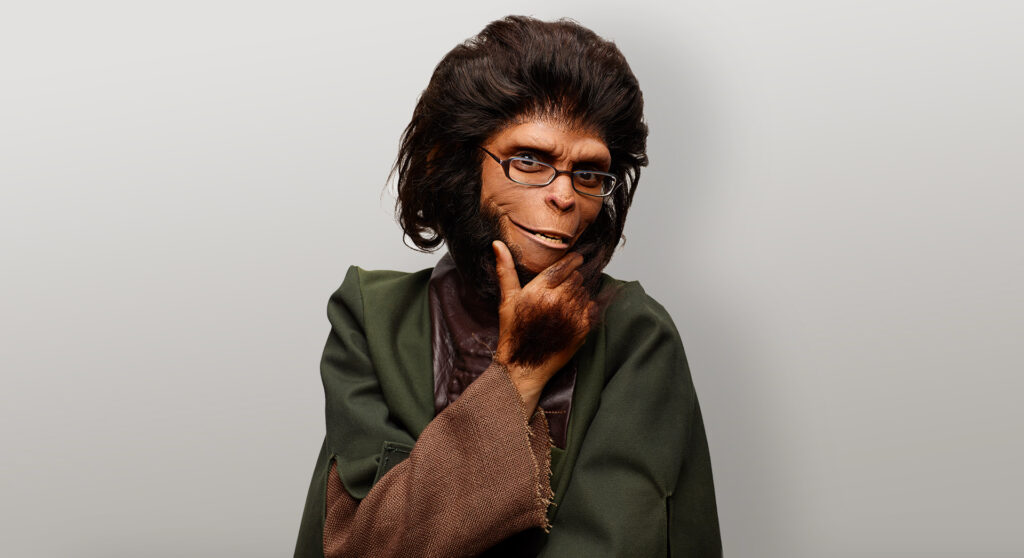

Mark e Rachel si teletrasportano a Porto Rico nel 2017.

Mark e Rachel si teletrasportano a Porto Rico nel 2017.

Immagina di camminare in una piazza affollata, impaziente di incontrare un amico. Passeggi con calma, nel frattempo un gruppo di 5 figure maschili ti circonda. Allungano le braccia, ti toccano sotto la vita e si passano una bottiglia di vodka tra loro.11Questo scenario è un riadattamento da un video pubblicato da SumOfUs, riportato dal «New York Post»: Adriana Diaz, Disturbing Reports of Sexual Assaults in the Metaverse: “It’s a Free Show”, «New York Post», 27 maggio 2022.

Ti senti spaventata e ti blocchi. Chiedi di smetterla. Alla fine si annoiano e, rispondendo alle tue suppliche, dicono: «Se non vuoi questo, la prossima volta non scegliere un avatar femminile»; oppure: «Non essere stupida, non era reale», «Non fingere che non ti sia piaciuto».22Nina Jane Patel, Fiction vs. Non-Fiction, Medium, Kabuni, 4 febbraio 2022.

Benvenuti nel metaverso.

Se non fosse avvenuta in un ambiente pixelate, questa scena costituirebbe senza dubbio, come minimo, una violenza sessuale. Ma buona parte dei meta-credenti, dei meta-utenti e dei meta-bros ti diranno che nel metaverso non esiste l’assalto. Non esiste il crimine. Perché? Perché è solo un gioco. Il tuo avatar non è veramente te. Puoi togliere e spegnere il tuo visore in qualsiasi momento. Smettila di fare la guastafeste.

Alla base di questa argomentazione vi sono due punti chiave: (i) il metaverso non è realmente “reale” e (ii) il tuo avatar non è veramente “te”. Entrambi i punti sono tuttavia fallaci, come avremo modo di dimostrare.33In questo articolo, mi riferirò principalmente a Meta e al suo metaverso “Horizon Worlds”. Naturalmente esistono più metaversi (Sandbox costituisce un altro esempio).

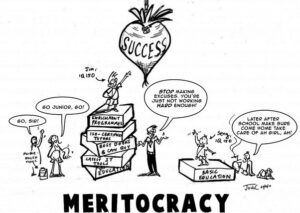

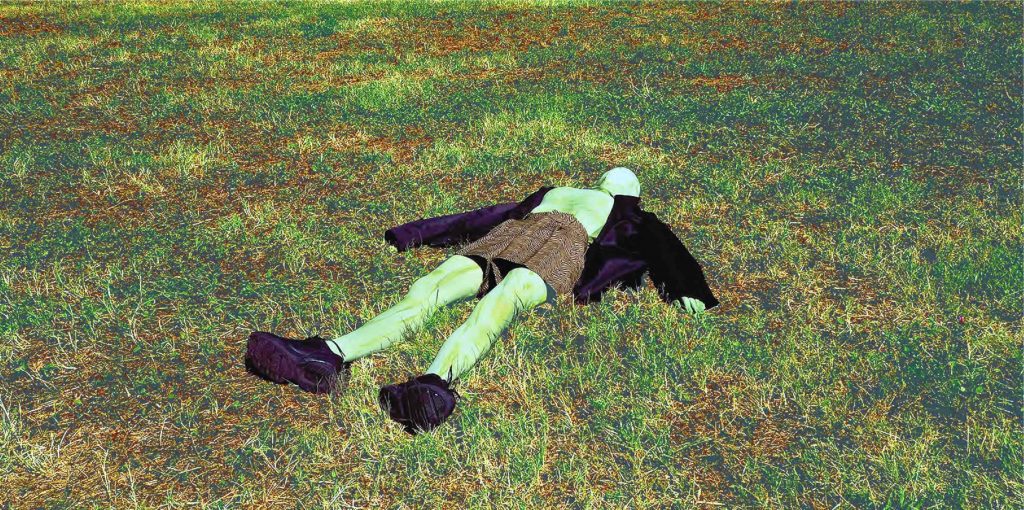

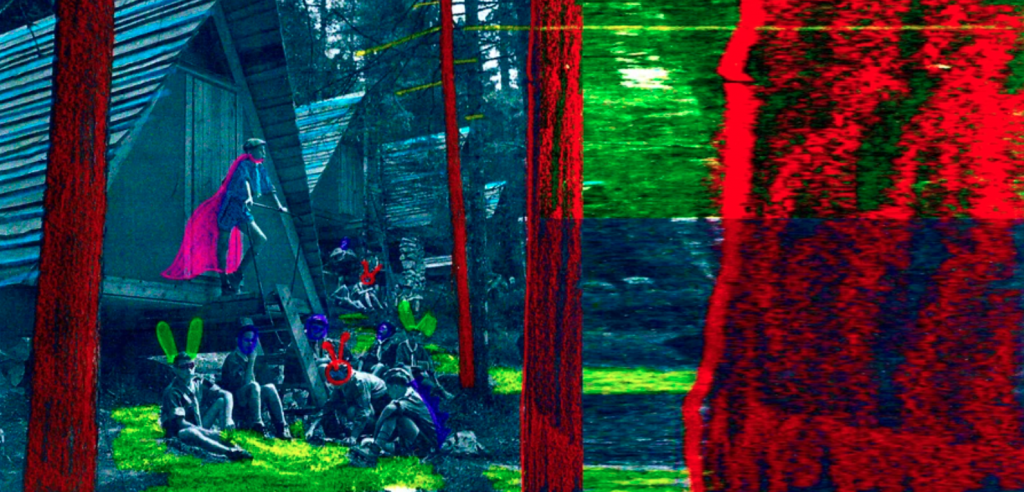

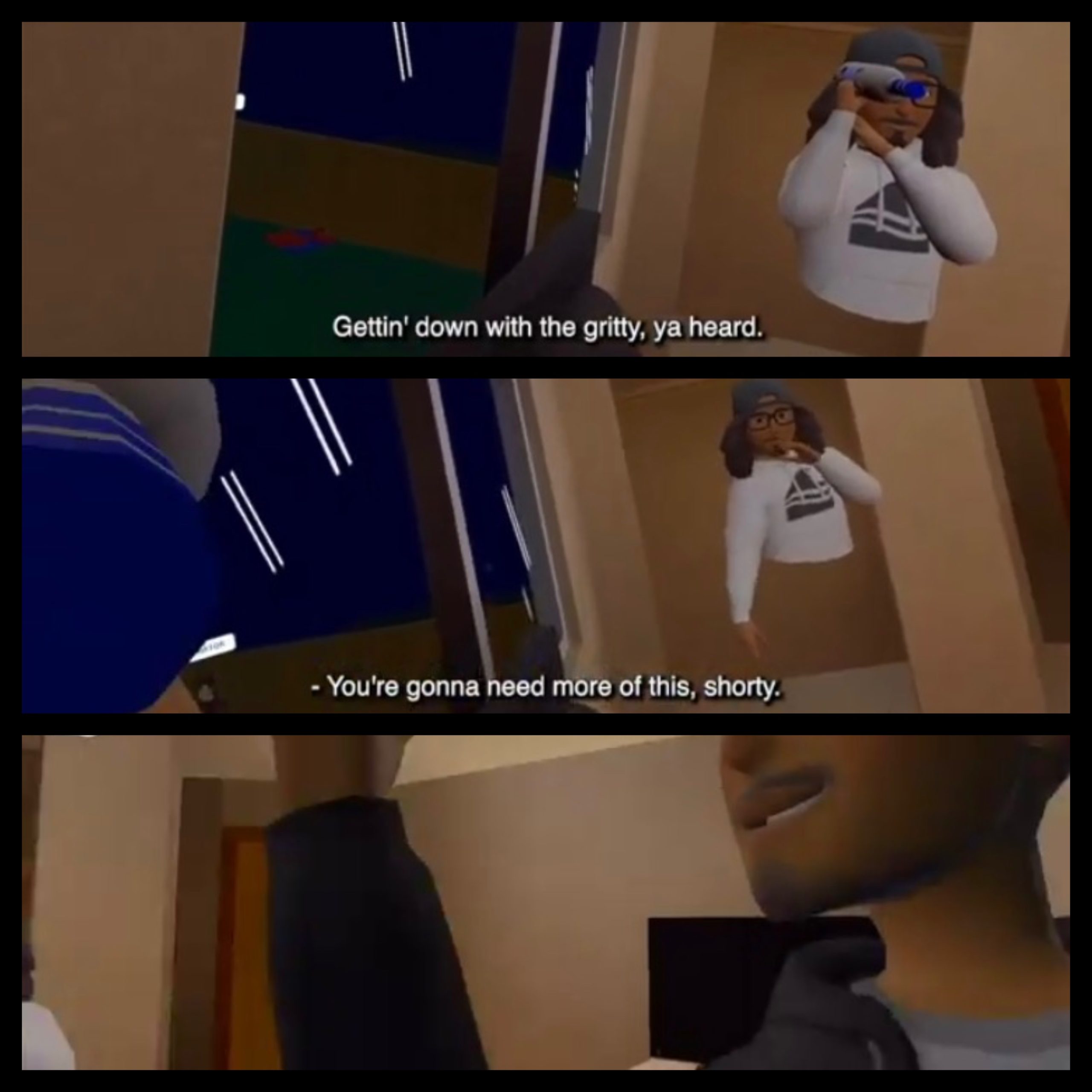

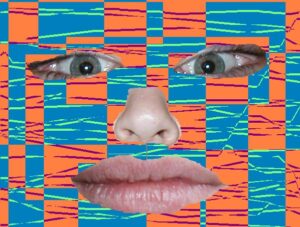

Un assalto nel metaverso: collage dal video di SumOfUs.

Un assalto nel metaverso: collage dal video di SumOfUs.

Si può commettere un crimine nel metaverso?

Chiaramente (ed enfaticamente): sì. Per commettere un crimine, solitamente servono l’intenzione e una vittima. Quindi, per dimostrare che ho intenzione di commettere un crimine, devo prima stabilire che a) la realtà virtuale è una realtà autentica e b) che il mio avatar sono io.

a) La realtà virtuale è reale?

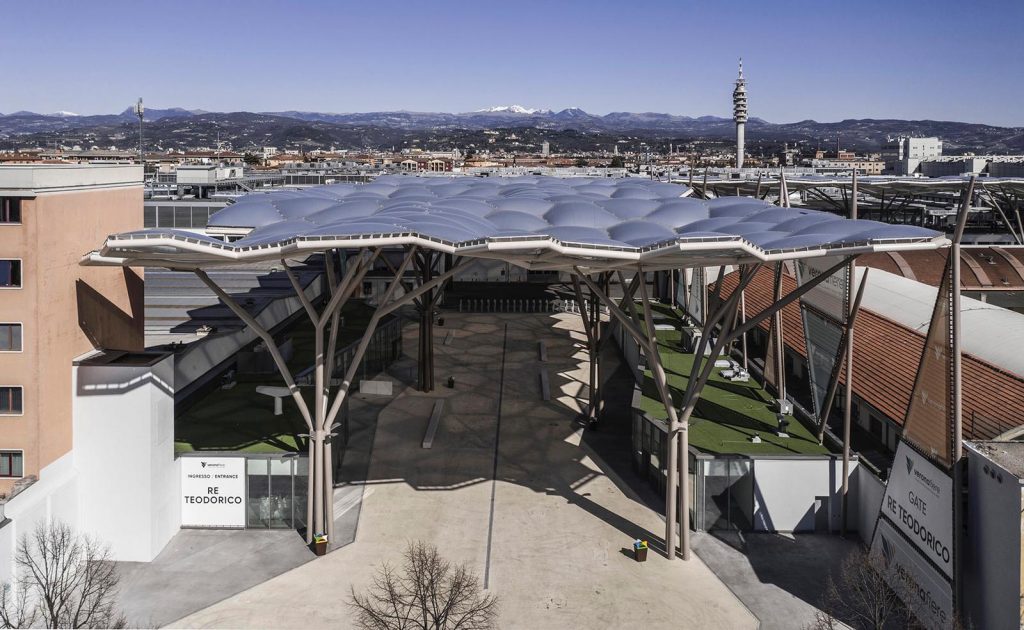

Per rispondere a questa domanda, cominciamo teletrasportandoci nel 2017. Facebook (all’epoca noto ancora solo come Facebook) desiderava dimostrare come la sua tecnologia VR, in fase di perfezionamento, potesse consentire a persone fisicamente distanti di poter scoprire luoghi e situazioni “teletrasportandosi” al loro interno (parola loro).

Mark Zuckerberg e Rachel Franklin (capo del social VR di Facebook) decidono quindi di visitare Porto Rico per assistere alle devastanti conseguenze dell’uragano Maria. Questo il loro dialogo:

– «Una delle cose davvero magiche della VR è che si può avere la sensazione di essere davvero in un luogo, io e Rachel non siamo nemmeno nello stesso edificio nel mondo fisico, ma ci sembra di essere nello stesso posto e di poterci guardare negli occhi», dice Zuckerberg, prima che lui e Rachel si diano il cinque (vedi sopra).

– «Si vede che ci sentiamo veramente come se fossimo qui» dice Franklin.

– «Questa strada è veramente allagata» aggiunge Mark.44«One of the things that’s really magical about VR is you can get the feeling you’re really in a place, Rachel and I aren’t even in the same building in the physical world, but it feels like we’re in the same place and can make eye contact» / «You can see that we can really feel like we’re here» / «This street is really flooded»; Olivia Solon, Mark Zuckerberg “Tours” Flooded Puerto Rico in Bizarre Virtual Reality Promo, «The Guardian», 10 ottobre 2017.

Ora, a parte il fatto che questa “iniziativa” è stata criticata per l’estrema mancanza di tatto (considerando l’immagine dei due avatar fluttuanti che si danno il cinque in una zona tragicamente disastrata), l’incidente mostra quanto siamo progrediti in termini di comprensione del significato di realtà virtuale e di come essa dovrebbe apparire.

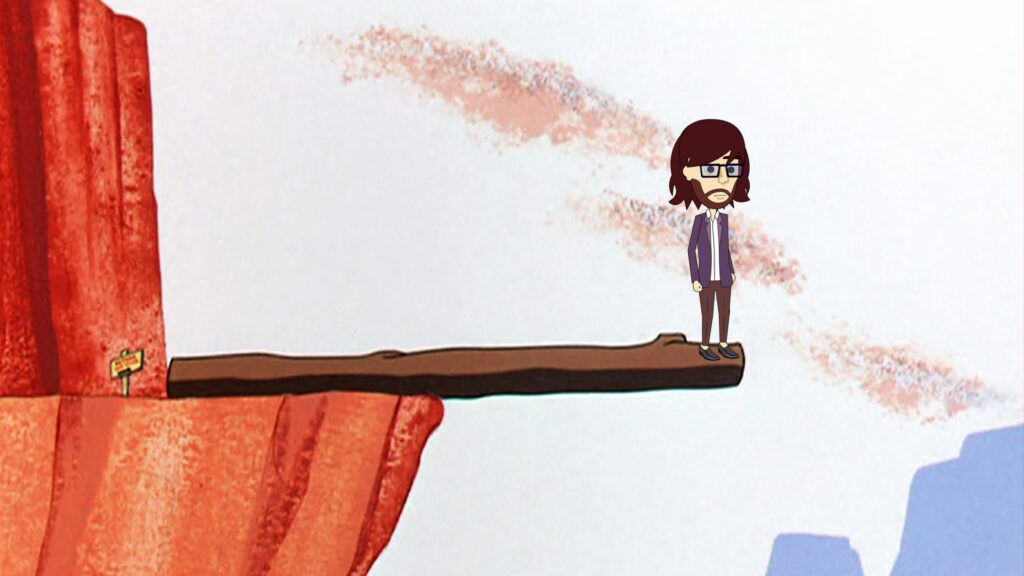

Nell’ottobre 2021 Zuckerberg annuncia il rebrand della società Facebook, Inc. in Meta, portandoci con il suo avatar in un tour del metaverso. Ma, oltre al fatto che il suo avatar è ora più corporeo e tridimensionale, la differenza principale è che l’ambiente circostante è un mondo pixellato. Zuckerberg non è sovrapposto su una foto a 360 gradi dell’ambiente fisico, sembra piuttosto trovarsi in Animal Crossing o The Sims. Ciò rappresenta un cambiamento fondamentale che ci consente di riconoscere che la realtà virtuale può essere una realtà autentica: una volta che smettiamo di cercare la piena equivalenza tra l’oggetto fisico e la sua controparte virtuale, possiamo accettare la realtà del mondo virtuale per quello che è.

ciò che accade nella VR accade davvero.

Ma questo cambiamento estetico rende davvero la VR reale? Non dipende piuttosto dal modo in cui operiamo al suo interno e se le nostre interazioni possono essere considerate parte della vita “reale”? Secondo David J. Chalmers,55David J. Chalmers, Reality+: Virtual Worlds and the Problems of Philosophy, Penguin Books, London, 2022.

non vi è alcun dubbio: ciò che accade nella VR accade davvero. In un mondo virtuale interattivo non si recita un copione creato da un programmatore di videogiochi, si compiono scelte reali. E, sebbene la realtà virtuale non abbia attualmente la potenza di un’immersione sensoriale completa (tatto, olfatto – ma ci arriveremo), non dovrebbe essere considerata una realtà di seconda classe.

Dopotutto, se sto intrattenendo in Horizon Worlds una conversazione profonda sulla vita con il mio amico, il fatto che entrambi siamo avatar o che siamo seduti su un divano virtuale non la rende meno reale: stiamo condividendo uno spazio, interagendo in tempo reale e scambiando pensieri reali.

Mark e (avatar) Mark nel 2021.

Mark e (avatar) Mark nel 2021.

Non si tratta solo di un’ipotesi: le aziende – anche quelle più tradizionali, come le società di consulenza – hanno cominciato ad accogliere Horizon Workrooms (l’offerta di Meta pensata per le aziende, in cui è possibile «incontrare i compagni di squadra dall’altra parte del tavolo, anche se si è dall’altra parte del mondo»). Ciò significa che già persino le aziende percepiscono come autentiche le interazioni nello spazio di lavoro virtuale: i colleghi stanno davvero collaborando a progetti e metteranno in pratica ciò che hanno discusso in modo tangibile, quantificabile e redditizio.

Quindi sì, la realtà virtuale è una realtà autentica, a patto che si riconosca che è indipendente (cioè non può essere paragonata) rispetto alla realtà fisica. La chiave di ciò che rende autentico e reale un mondo virtuale è il fatto che nessuno degli avatar con cui interagiamo è programmato al computer. Si tratta piuttosto di una rappresentazione di altri esseri umani reali che possiedono il libero arbitrio e scelgono come agire e parlare, proprio come farebbero nel mondo fisico. Nel momento in cui la realtà virtuale si basa sul fatto che gli avatar sono esseri umani che compiono scelte reali, per determinare quali crimini possano essere commessi nel metaverso diviene allora di fondamentale importanza la relazione con il nostro avatar.

b) Il mio avatar sono “io”?

Sarebbe impossibile affrontare la questione senza definire che cosa intendiamo per “io”.

Chi sei? Chiede il bruco ad Alice.

Chi sei? Chiede il bruco ad Alice.

(i) Chi è “me”? E ho solo un “me”?

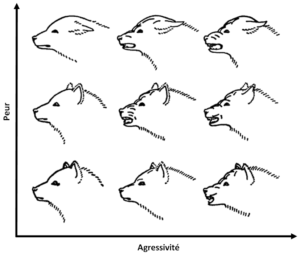

La psicologia moderna ha sviluppato numerose teorie dell’io e della personalità per affrontare tali questioni. Prima di addentrarci nella teoria, consideriamo la nostra esperienza quotidiana di “noi stessi”. Qualche anno fa ho cenato a Londra con un amico. Era quasi il suo compleanno e gli chiesi se stesse organizzando qualcosa. Mi spiegò, come se fosse la cosa più normale del mondo, che avrebbe organizzato tre feste diverse: una con gli amici di scuola, una con gli amici dell’università e una con gli amici dell’età adulta. Perplessa, gli chiesi perché non avesse organizzato un’unica festa, invitandoli tutti. La sua risposta fu che non voleva che si incontrassero. Non che gli amici non potessero andare d’accordo, ma che potessero rivelare l’uno all’altro lati di lui che intendeva mantenere separati. Da allora ho conosciuto diverse altre persone che ammettono apertamente di sentire il bisogno di tenere separati alcuni gruppi, per preservarsi dallo scrutinio. E riflettendo ulteriormente, ho iniziato a capire che si tratta di una versione esasperata di ciò che facciamo quotidianamente, quasi ogni ora: code-switching (ovvero, lo scambio di codici).

Inizialmente, il termine code-switching descriveva i comportamenti linguistici di persone bilingui in grado di passare da una lingua all’altra, spesso anche all’interno della stessa frase. Oggi, tuttavia, il termine ha assunto un significato più ampio, tipicamente in riferimento a classi sociali e aspetti etnici/razziali. Si tratta di «adattare il proprio linguaggio, stile di parola, aspetto, comportamento ed espressione in modo da ottimizzare il comfort degli altri in cambio di un trattamento equo, di un servizio di qualità e di opportunità di lavoro».66Courtney L. McCluney et al., The Costs of Code-Switching, «Harvard Business Review», 15 novembre 2019.

Tra gli esempi di code-switching diventati virali troviamo Obama (i) che ha salutato Kevin Durant con un abbraccio e un “my man” dopo aver formalmente stretto la mano all’assistente allenatore bianco della squadra di basket statunitense e (ii) che ha risposto «nah we straight» a una richiesta di resto da parte di un dipendente nero di un fast-food in un quartiere di Washington a maggioranza nera.77Gene Demby, How Code-Switching Explains the World, «NPR», 8 aprile 2013.

Obama saluta l’assistant coach vs Kevin Durant.

Obama saluta l’assistant coach vs Kevin Durant.

Per molti di noi, il code-switching è un semplice caso di piccoli cambiamenti: magari enfatizziamo leggermente alcuni tratti del nostro carattere senza abbandonare quello che consideriamo il nostro vero io olistico. È qualcosa che facciamo istintivamente quando passiamo dall’interazione con i colleghi di lavoro a quella con gli amici. Ma vi è un costo elevato associato al code-switching: più è la distanza tra il tuo vero io e il personaggio che metti in scena per un determinato pubblico, più neghi il tuo vero io/sopprimi la tua vera personalità, più ciò risulta drenante dal punto di vista fisico e psicologico. Lo scambio di codici ci aiuta a comprendere che la nostra personalità – e quindi il nostro senso di sé – è sfaccettata. Ma per giungere a questa conclusione la psicologia ha impiegato del tempo.

Prendiamo in considerazione per questo articolo le teorie che prevedono la molteplicità/sub-sé vista non come una completa separazione del sé , ma come una visione scissa del sé: frammenti che compongono l’intero “io”. Forse la teoria che oggi sembra più applicabile è quella di Carter.99Rita Carter, Multiplicity: The new science of personality, identity, and the self, Little, Brown & Company, 2008.

Carter riconosce che, pur avendo un collezione di sé multipli, questi sono classificati in principali, minori e micro sé: un sé principale è un «un personaggio pienamente formato con pensieri, desideri, intenzioni, emozioni, ambizioni e credenze».1010Ibid., p. 23.

I sé minori sono meno complessi dei sé maggiori e tipicamente vengono esternati in situazioni particolari (per esempio, litigare con qualcuno, sentirsi obbligati a fumare – in breve, costituiscono il code-switching). Infine, i micro sé sono «elementi costitutivi della personalità», come idee ricorrenti, abitudini, tic vocali o fisici. I micro sé si combinano per formare i minori, e i minori possono combinarsi per formare i maggiori. Secondo Carter, il motivo per cui sviluppiamo un senso di sé è che ci identifichiamo con uno dei nostri sé principali. Quando non riusciamo a identificarci con esso, allora sperimentiamo gli altri sé, e cerchiamo di sviluppare la nostra personalità fino a scoprire ciò che ci fa sentire veri a noi stessi.1111David Lester, A Multiple Self Theory of the Mind, «Comprehensive Psychology», gennaio 2012.

Visto attraverso le lenti della teoria dei sub-sé di Carter, il code-switching diventa uno strumento attraverso cui possiamo accedere ai sub-sé e scoprire il nostro sé principale/vero. Se ogni volta che mi reco a lavoro devo annientare quelli che identifico come i miei tratti fondamentali, allora mi rendo conto che il personaggio che sto indossando non sono io. Ma se, quando cambio codice, sto semplicemente esplorando lati di me che sento ancora fedeli al mio nucleo (me-estroverso; me-professionale; me come figlio; me-assertivo), devo allora riconoscere che ognuno di essi rappresenta una parte di me e che, nel loro insieme, costituiscono il mio essere, il mio senso di sé, appunto “me”.

(ii) Chi è il “me” digitale?

Dal momento che ormai accettiamo che in ogni interazione venga presentato un certo lato di noi stessi (ma pur sempre nostro) all’interlocutore, possiamo dire lo stesso delle nostre interazioni sui social media? Sono anch’esse parte del nostro io esteso?

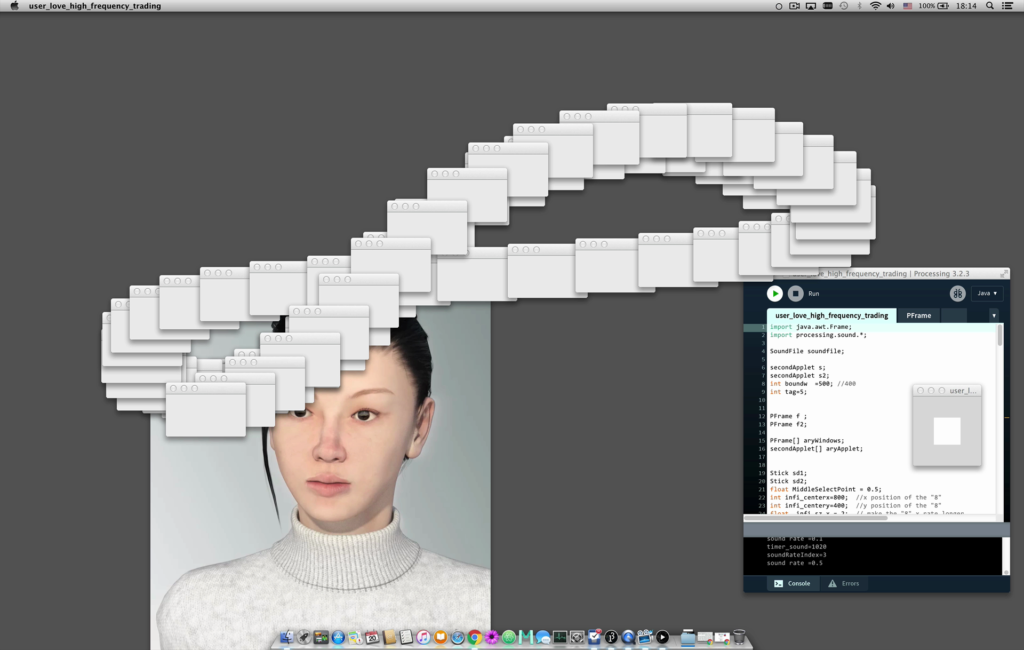

La Dolly Parton Challenge.

La Dolly Parton Challenge.

Nel gennaio 2020, la cantante Dolly Parton ha condiviso un meme che è diventato noto come la “Dolly Parton Challenge”. Parton ha scelto quattro diverse immagini di sé stessa e le ha etichettate in base alla piattaforma di social media a cui si sarebbero meglio adattate. La Dolly professionista vive su LinkedIn. Quella natalizia è orientata alla famiglia su Facebook. La Dolly artistica vive su Instagram. Mentre la Sexy-Dolly vive su Tinder. Il meme è diventato virale poiché moltissimi hanno ricreato il suo collage. Risultava essere vero. Così vero che una giornalista del «Time» ha commentato così:

«A seconda della piattaforma social, vi è un altro lato della propria personalità che si sceglie di condividere con il mondo. Ovviamente, è del tutto naturale rivelare aspetti diversi della propria vita su Facebook rispetto a Instagram, e ognuno di noi è in realtà un amalgama di sé a seconda della situazione sociale».1212«Depending on the social platform, there is another side of your personality you choose to share with the world. Of course, it’s perfectly natural to reveal different aspects of your life on Facebook than you would on Instagram and everyone is really just an amalgam of selves depending on the social», Ashley Hoffman, Dolly Parton Challenge Inspires Multiple Personality Memes, «Time», 29 gennaio 2020.

L’autrice presenta il code-switching online (e quello di persona) in modo semplice: «Ovviamente, è del tutto naturale», «Ognuno di noi è in realtà solo un amalgama di sé». Ciò, tuttavia, non è sempre stato così anche per l’online. Per molto tempo, infatti, Internet ha prosperato sull’anonimato. I vecchi forum non mostravano alcuna foto del profilo, mentre i nomi degli utenti non avevano necessariamente a che fare con le generalità delle persone. Vi era insomma una netta separazione tra il nostro io online e il nostro io in carne e ossa (non da ultimo perché, a quel tempo, la maggior parte delle interazioni sociali avveniva di persona). Nel periodo 2007-2010, una piattaforma come Tumblr veniva utilizzata da molti utenti alla stessa stregua di un diario segreto. Chatroulette e Omegle si configuravano invece attraverso feed video di persone dai volti tagliati, per preservare l’anonimato, senza alcuna aspettativa sul loro “vero” io. Al contrario, la norma era quella di mettere alla prova i nostri limiti, assumendo diversi personaggi in nome del divertimento e delle stranezze di Internet. Le cose cominciarono a cambiare in modo incrementale (e poi esponenziale) con Facebook, con l’avvento delle immagini di profilo e la caduta di Tumblr. Come afferma un ex utente:

«Penso che parte di [ciò che ha fatto morire Tumblr] sia stata la crescente vanità intorno alle piattaforme social, dove la tua immagine e i tuoi contenuti forniscono una ricompensa per la condivisione di te stesso o di una versione modificata di te stesso. Anche se è possibile farlo su Tumblr, mi sembra che fosse più un luogo per curare i contenuti e per le moodboard, il che non corrispondeva alla direzione che la società stava prendendo».1313«I think part of [what made Tumblr die] was the growing vanity around social platforms, where your image and content provides a reward for sharing yourself or an edited version of yourself. Even though you can do that in Tumblr, I feel like it was more of a place for curating content and mood boards, which didn’t match the direction that society was heading», Jennimai Nguyen, Tumblr Died a Slow and Painful Death. Here’s How TikTok Can Avoid the Same Fate, «Mashable», 29 ottobre 2021.

L’acquisizione di Tumblr da parte di Yahoo nel 2013 per 1,1 miliardi di dollari lo ha dimostrato. Quando Yahoo ha tentato di ottenere ricavi da Tumblr adottando il noto modello della pubblicità mirata, ha fallito: Tumblr non era incentrato sulla conoscenza della vera identità dei suoi utenti (nome reale, luogo, età e volto), e non era pertanto in grado di fornire informazioni adeguate. In altre parole, gli inserzionisti non potevano contare sul fatto che i propri prodotti venissero promossi alle persone giuste, traducendosi così in vendite.

Con Facebook, tuttavia, il volto comincia a essere indissolubilmente legato al nome (reale), consuetudine che si stabilizza anche con l’avvento di altri social network successivi. Seguono rapidamente due fenomeni: (i) la possibilità di scambiare il proprio anonimato con la fama e il riconoscimento, a seguito di un processo di costruzione del proprio personal brand ottenuto attraverso la pubblicazione su piattaforma dei contenuti; (ii) l’entrata a regime del valore di autenticità – che si sostituisce al precedente anonimato – garantito dalla compresenza del proprio volto e del proprio nome e cognome. Per certi aspetti, si tratta di un cambiamento a quel tempo gradito, poiché adesso finalmente eravamo in grado di sapere che chi comunicava con noi online era realmente chi diceva di essere. Oggi ci aspettiamo di scoprire qualcosa su una persona semplicemente cercando il suo nome su Google o il suo profilo Instagram. Gli interessi che condividiamo online devono essere autentici. In altre parole, il nostro io online deve essere il nostro vero io.

Sebbene sia consentito un piccolo margine per il code-switching, in ultima analisi oggi siamo giunti a credere che non esista alcuna distinzione tra chi siamo di persona e chi siamo online, e che forse non dovrebbe persino esistere alcuna distinzione. Un datore di lavoro che intenda esaminare i candidati può sentirsi autorizzato a prendere una decisione in base a ciò che trova online.

(iii) Il mio avatar è anche “io”?

Adesso possiamo tornare alla domanda iniziale con maggiore consapevolezza. Immaginiamo di creare un avatar su Horizon Worlds (o in qualsiasi altra esperienza VR). Che aspetto avrebbe? Forse di istinto, faremmo in modo che corrisponda alle nostre caratteristiche fisiche Siamo infatti talmente abituati a equiparare il nostro io fisico a quello digitale in nome dell’autenticità che probabilmente non ci sentiremmo troppo a nostro agio se il nostro avatar non ci rappresentasse, almeno in parte, fisicamente. Al contrario, alcuni, meno a proprio agio con il proprio corpo, potrebbero invece scegliere volutamente di farsi rappresentare da un avatar che non corrisponde ai propri attributi fisici.

Il documentario del 2018 Digital Selves: My Avatar is Me! ha seguito 13 persone disabili che hanno adottato avatar molto diversi nella realtà virtuale:1414Bernhard Drax, Our Digital Selves: My Avatar Is Me!, 18 maggio 2018.

alcuni di loro hanno scelto di rappresentare il proprio corpo così com’era nel mondo fisico, mentre altri hanno scelto di vivere la realtà virtuale in un corpo diverso. Quando sono stati intervistati, un partecipante ha affermato: «Non sto negando il mio corpo fisico. È un’altra parte di ciò che sono». I nostri avatar non sono dunque solo una nostra rappresentazione nel mondo virtuale. Soprattutto quando rappresentano un’espressione più “vera” della nostra identità, una parte più profonda di ciò che siamo, ci identifichiamo con i nostri avatar (anche quando, o proprio perché, non ci assomigliano) e creiamo con essi una sorta di legame. Questo, secondo Jessica Wolfendale,1515Jessica Wolfendale, My Avatar, My Self: Virtual Harm and Attachment, «Ethics and Information Technology», 9, 2007, pp. 111-119.

avrebbe un significato etico, poiché più la nostra esperienza dei corpi virtuali diventa ricca e immersiva, più qualunque violazione del nostro corpo virtuale sarà sentita e possibilmente assimilata a una violazione del nostro corpo fisico.

Abbiamo così stabilito che: (i) la realtà virtuale è “reale”, in quanto i partecipanti sono esseri umani che compiono scelte reali nelle loro interazioni“…la realtà virtuale è “reale”, in quanto i partecipanti sono esseri umani che compiono scelte reali nelle loro interazioni”; e (ii) i nostri avatar sono un’altra espressione del nostro io multiforme e, in alcuni casi, potrebbero persino essere un’espressione più vera del nostro io.

Si può commettere un crimine contro un avatar?1616I commenti sono stati presi da un video della CNBC, presente su YouTube, in cui si parla di abusi nel metaverso. Molti ridicolizzano la giornalista che racconta la sua esperienza di molestie e palpeggiamenti. Ho selezionato quelli che collegano la VR al gioco online e che giustificano l’abuso come legittima aspettativa dell’esperienza VR, o come un qualcosa che alla reporter “probabilmente piace”. Altri hanno descritto l’avatar della giornalista come “nemmeno così sexy”. Ho scelto di non rimuovere i nomi degli utenti, considerato che si tratta di commenti pubblici. Si noti che l’espressione tea bagging si riferisce in Call of Duty a un giocatore che si posiziona sopra un altro giocatore ucciso simulando un atto sessuale per umiliarlo.

Coloro che sostengono che la risposta sia “no” tendono a tracciare delle similitudini (se non una completa equivalenza) tra la VR e i videogiochi: poiché in un videogioco non vi può essere una vittima reale, allora non ve ne può essere una nemmeno nella VR. In questo modo, però, si ignora la differenza fondamentale tra il videogioco – in cui gli utenti recitano un copione o una missione dettata dal programmatore – e la VR, in cui gli avatar sono del tutto controllati dietro lo schermo da esseri umani che comunicano e vivono un’esperienza aperta e priva di missioni. Fare una strage in Grand Theft Auto ha un impatto solo su di te, sul tuo computer e (in modalità multigiocatore) su coloro che hanno scelto di giocare con lo stesso copione/missione. Nel metaverso, invece, ha un impatto su tutte le altre persone che si teletrasportano con i propri avatar e non si sono iscritte alla medesima “missione”. Il metaverso non è un gioco, ma è più simile a una piazza pubblica. Inoltre, se pure vi fosse equivalenza tra gioco e VR, ciò non significherebbe comunque che un crimine sia privo di vittime, come vedremo.

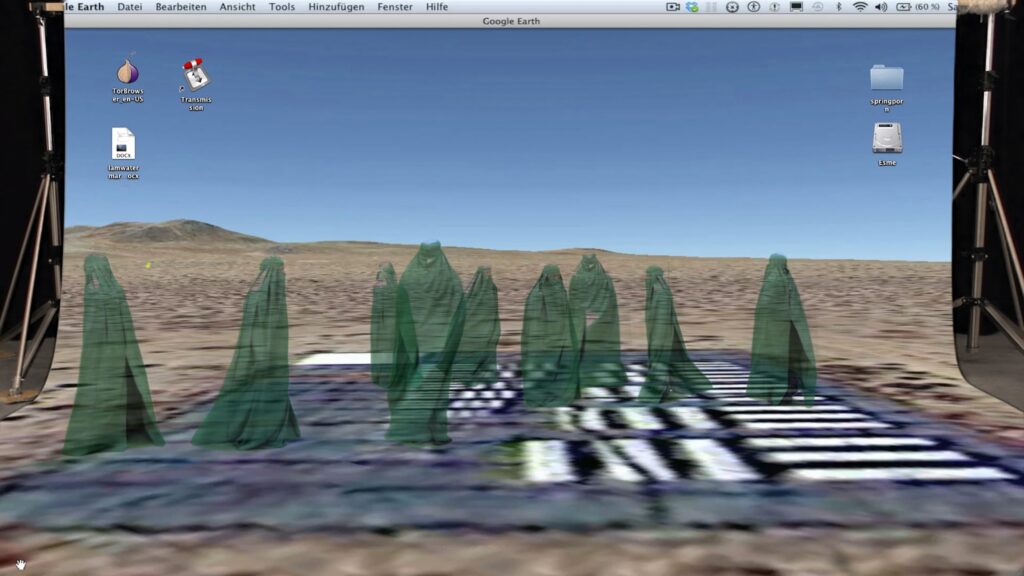

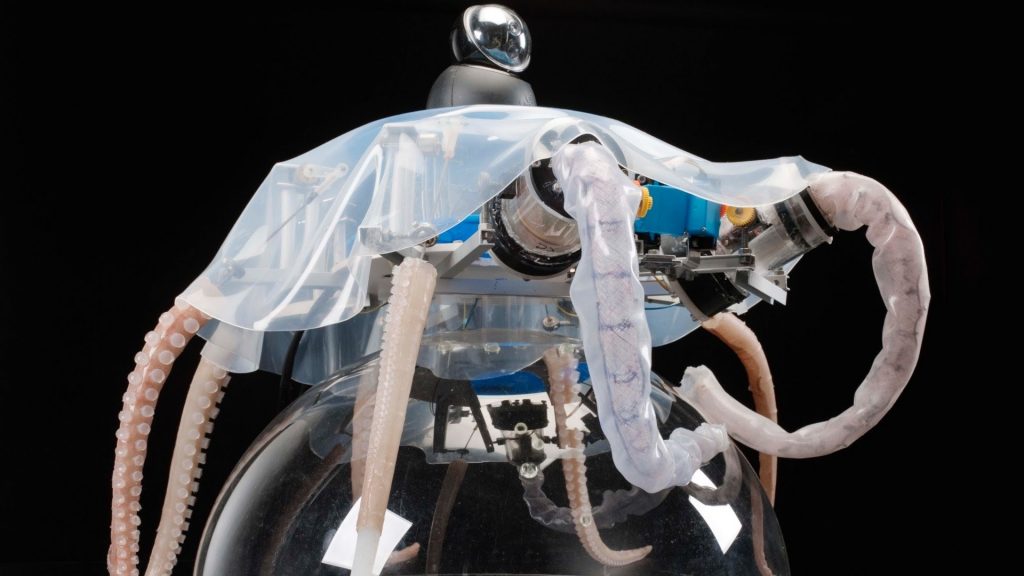

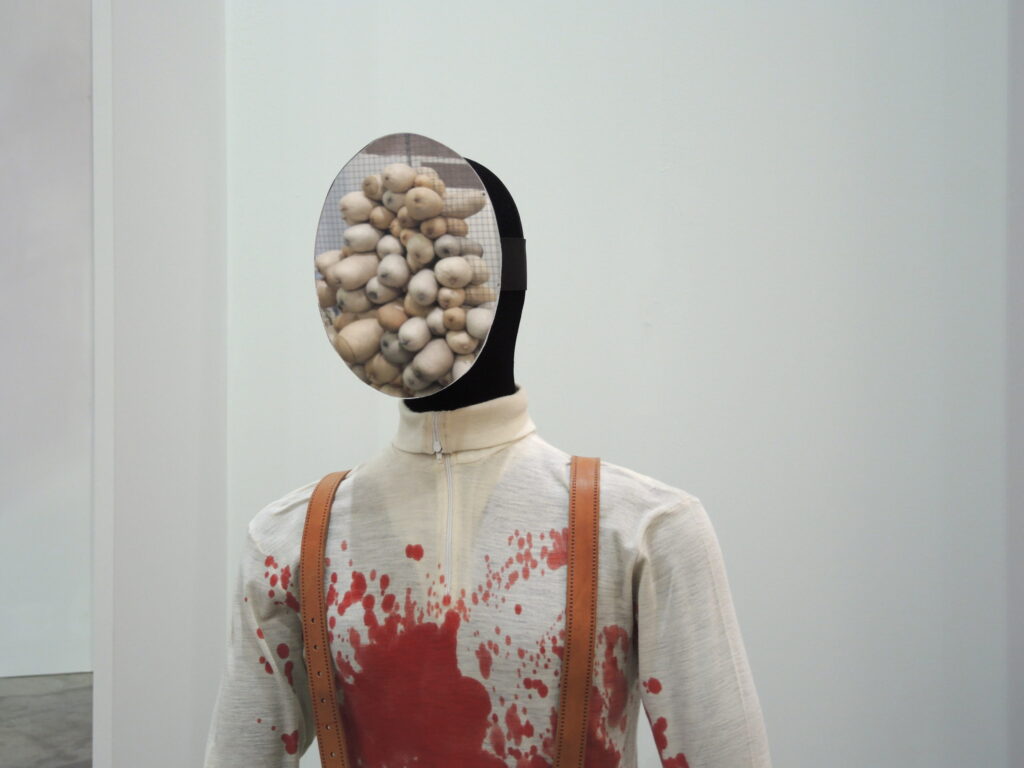

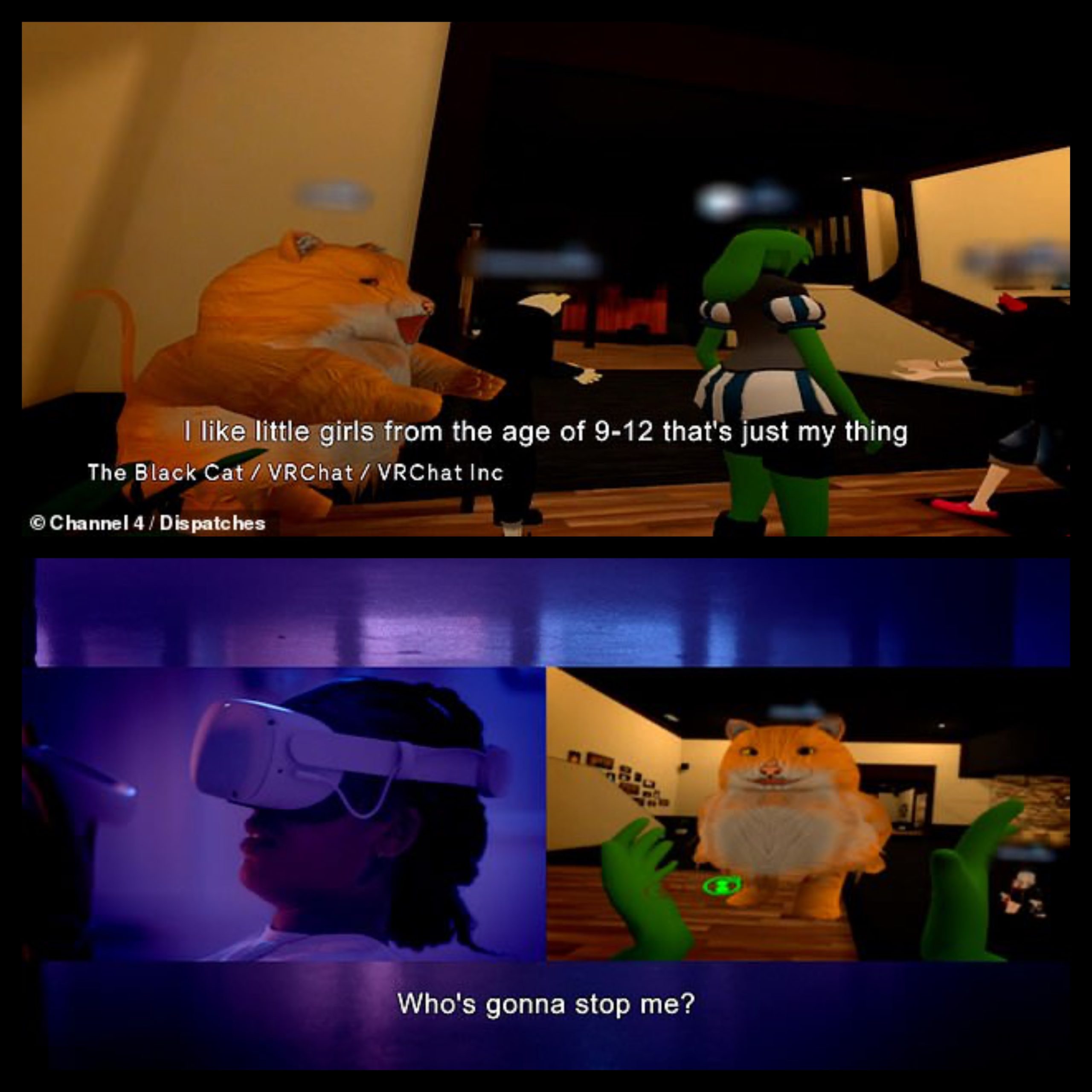

Il gatto rosso nell’investigazione di Channel 4.

Il gatto rosso nell’investigazione di Channel 4.

Ripensiamo allo scenario descritto all’inizio di questo articolo, molto frequente nelle esperienze VR. Per esempio, la reporter di «Channel 4» Yinka Bokinni1717Yinka Bokinni, Inside the Metaverse: Are You Safe? Dispatches, «Channel 4», 25 aprile 2022.

ha creato nel metaverso il profilo di una tredicenne. Nonostante la giovanissima età fosse indicata nel suo avatar, la reporter è stata subito circondata da predatori che le hanno ripetuto di togliersi la safety bubble, ovvero la “bolla di sicurezza”.1818Le safety bubbles variano da piattaforma a piattaforma, ma generalmente consistono in una funzione attivabile che permette ad altri utenti di avvicinarsi al tuo avatar, ma solo a circa un metro di distanza. Se un altro utente prova ad avvicinarsi per toccarti, le sue mani e il corpo scompaiono dalla vista e lasciano solo una testa fluttuante.

Discorsi di odio, razzismo estremo e commenti del tipo «Mi piacciono le ragazzine dai 9 ai 12 anni» hanno fatto parte dello scenario. Dopo aver alzato le mani e chiesto con forza e ripetutamente al gatto rosso di allontanarsi, l’avatar ha continuato a ripetere «Chi mi fermerà? Chi mi fermerà?», mentre un altro sullo sfondo spiegava che il gatto rosso si stava descrivendo come uno stupratore. Per molti versi, tutto questo sembra un ritorno ai tempi in cui gli utenti di Internet erano anonimi e quindi liberi di trollare o abusare altri utenti, senza conseguenze.

Ora, è importante ammettere, per rispetto e riconoscimento delle vittime di abusi fisici e sessuali, che un’aggressione nel metaverso non può essere equiparata a un’aggressione nel mondo fisico. Lì, infatti, puoi togliere le cuffie VR e scegliere di non rientrare più. Tuttavia, tutta la narrazione intorno alla VR sottende proprio la fusione e, quindi, la piena corrispondenza tra l’esperienza virtuale e quella fisica. A tale proposito, Zuckerberg propone di indossare, in un futuro prossimo, una tuta aptica che sia in grado di trasmetterci sensazioni tattili all’interno del metaverso.1919Sam Shead, Mark Zuckerberg Says a New Skin-like Material Could Support Metaverse Ambitions, CNBC, 1 novembre, 2021.

Una volta che ci si è immersi completamente e ci si sente incarnati, le risposte fisiche e psicologiche agli abusi nel metaverso potrebbero dunque non essere così diverse da quelle provate nella vita reale. Più diventa realistica l’immersione nel metaverso, più le esperienze nella VR attiveranno le medesime risposte cerebrali che si attiverebbero in presenza. Nel caso di un abuso, si potrebbe pertanto sviluppare un disturbo post-traumatico da stress (PTSD). Inoltre, se è vero che è possibile disconnettersi dalla VR, è altrettanto vero che un abuso subito, per esempio, su Horizon Workspace da parte di un collega, non affrancherebbe la vittima dall’essere costretta a far ritorno in quell’ambiente.

Abbiamo visto come piattaforme digitali bidimensionali quali Instagram e YouTube abbiano portato adolescenti e adulti vulnerabili all’autolesionismo e, in alcuni casi, al suicidio. Siamo arrivati ad accettare che il trolling online abbia conseguenze gravi, a volte fatali. Bisognerebbe cominciare a prendere in considerazione che essere molestati e abusati in una realtà immersiva comporti dei rischi inevitabili: per esempio, l’inchiesta di «Channel 4» ha dimostrato che i bambini in VR sono facilmente esposti a un linguaggio poco adatto alla loro età, a comportamenti espliciti, fino ad arrivare a vere e proprie molestie e abusi.

È chiaro che, poiché gli ambienti virtuali sono reali e i nostri avatar sono parte di noi, le azioni del nostro avatar corrispondono alle nostre azioni. Se scegliamo di abusare o molestare un avatar che è la rappresentazione di un essere umano reale, non possiamo davvero pensare che questo non abbia conseguenze reali. Ma è sempre così? Va quindi promulgata una legislazione che sia in grado di affrontare questo problema? E che conseguenze potrebbe avere, invece, commettere crimini nei confronti di avatar programmati al computer?“…che conseguenze potrebbe avere, invece, commettere crimini nei confronti di avatar programmati al computer?”

Innanzitutto, è possibile commettere un crimine nei confronti di un avatar programmato al computer?2020Immagine che segue: HydraSparky, Pedestrians Being Killed in GTA, GTA5-Mods, 25 gennaio 2018.

Se pensassimo a un videogioco multigiocatore come Call of Duty, il cui scopo è quello di uccidere il nemico prima che sia lui a uccidere te, la risposta a questa domanda sarebbe no: in questo caso si tratterebbe semplicemente delle regole del gioco.

Una strage di pedoni in GTA.

Una strage di pedoni in GTA.

Invece, in un videogioco come Grand Theft Auto, la possibilità di uccidere liberamente personaggi generati al computer e non controllati da esseri umani non ha nulla a che fare con lo scopo del gioco (che è quello di completare una serie di missioni, che pure prevedono uccisioni, ma motivate). Tuttavia, anche in questo caso, non diremmo di star commettendo un crimine: nessuno si sta realmente facendo del male.

Pensiamo invece a un videogioco la cui missione sia quella di molestare l’avatar di un bambino programmato al computer: molti di noi riterremmo a ragione di trovarci di fronte a un gioco sbagliato e con molta probabilità non vorremmo affatto giocarci.

Sono pochi i casi legali che affrontano tali questioni. Uno di questi è stato presentato alla Corte Suprema degli Stati Uniti. Anche se non intendo considerare il ragionamento della Corte come determinante per gli standard etici/morali che dovremmo applicare, si tratta di un’interessante istantanea nel tempo.

Nel 2002, il governo degli Stati Uniti ha sostenuto che la pedopornografia virtuale dovesse essere inclusa nel Child Pornography Prevention Act (1996). Ma la Corte Suprema ha stabilito che la pedopornografia virtuale e la pedopornografia vera e propria si distinguono in base al fatto che la prima «non registra alcun crimine e non crea vittime con la sua produzione… Mentre il Governo [statunitense] ritiene che le immagini possano portare a casi effettivi di abuso di minori, il nesso di causalità è contingente e indiretto» e che «la semplice tendenza di un discorso a incoraggiare atti illeciti non è una ragione sufficiente per vietarlo».2121«Records no crime and creates no victims by its production…While the Government asserts that the images can lead to actual instances of child abuse, the causal link is contingent and indirect»; «The mere tendency of speech to encourage unlawful acts is not a sufficient reason for banning it»; Ashcroft v. Free Speech Coalition, Encyclopædia Britannica.

Ora, pur non trattandosi di un reato, è opportuno limitare certi comportamenti nei confronti di avatar programmati al computer? Se ci comportiamo in modo abusivo nei confronti di un avatar programmato al computer, e questo non costituisce di per sé un crimine, ciò potrebbe comunque avere ripercussioni su altre persone (non programmate al computer)?

Il dibattito sulla rappresentazione della violenza nei videogiochi è vecchio di decenni. Tuttavia, nella circostanza in cui assumiamo comportamenti violenti e abusivi attraverso il nostro avatar, all’interno di un mondo completamente immersivo, un aspetto per certi versi inedito da tenere a mente è l’effetto Proteo, vale a dire la tendenza di un avatar o di un’altra rappresentazione digitale di noi stessi a influenzare le nostre azioni (per esempio, se scelgo un avatar più alto della mia persona nella vita reale, potrei sentirmi più sicura nelle mie interazioni online con gli altri utenti). Gli psicologi Rosenberg e Bailenson sono giunti alla conclusione che quando gli utenti vivono la realtà virtuale da supereroi si comportano in modo più altruistico anche offline. Considerando quanto ancora poco si sappia sugli effetti a lungo termine dell’influenza del proprio avatar e viste le zone grigie di una simile analisi, è molto difficile sviluppare la questione a livello normativo e legislativo. Ma che cosa accade, invece, se si sceglie di abusare di un avatar controllato dall’IA, le cui future conversazioni con gli utenti dipenderanno dal modo in cui lo si tratta?

Poiché gli avatar IA non sono senzienti, stiamo provando a determinare se il mio abuso di un avatar IA possa portare a vittime umane e se questo debba far scattare alcune norme o linee guida per limitare il mio comportamento (anziché criminalizzarlo).

Per illustrare il punto, analizziamo Replika, un’applicazione tramite cui è possibile interagire con un compagno IA. Nella versione gratuita, il compagno IA sarà tuo amico, ma pagando l’abbonamento premium si potrà impostare la relazione come si desidera: Replika può diventare un partner romantico, un genitore, un familiare.

Esistono forum online, tra cui Reddit, in cui uomini paraplegici discutono di quanto sia utile l’app, perché si sentono sostenuti e amati dalla loro compagna IA in un modo che ritengono impossibile nella vita reale.2222Reddit, R/Replika – I Don’t Think It’s Bad, but Why Do People Date Their Replikas?.

Ma, all’altro capo dello spettro, vi sono uomini che scelgono di abusare della loro Replika attraverso il gaslighting, sminuendo, negando l’affetto o attraverso altri comportamenti che nel mondo fisico si qualificherebbero come abusi.

Ancora una volta, non si intende qui equiparare un avatar IA a una donna in carne e ossa che soffre per mano di un abusatore. Tuttavia, occorre tenere presente che un’IA cresce e si sviluppa. E – a seconda dei metodi di apprendimento con cui è stata programmata – ciò che scriviamo e il modo in cui la trattiamo influenzano le sue future interazioni con noi e con altri utenti. In altre parole, se interagisco con la mia Replika attraverso discorsi misogini, razzisti e di odio, quel linguaggio potrebbe essere normalizzato dall’IA e utilizzato contro altri utenti, come illustrato da Tay, il chatbot IA della Microsoft che, dopo meno di 24 ore su Twitter, è stato sospeso perché ha cominciato a spargere odio.2323Elle Hunt, Tay, Microsoft’s AI Chatbot, Gets a Crash Course in Racism from Twitter, «The Guardian», 24 marzo 2016.

Le mie azioni potrebbero dunque avere conseguenze su altri. Così, nel metaverso, dove con le nostre azioni potremmo commettere crimini contro avatar controllati da esseri umani o influenzare negativamente il comportamento di avatar controllati dall’IA, con ripercussioni su altri utenti.

Per quanto riguarda la regolamentazione in senso lato (e questo vale per le condotte abusive nei confronti di avatar puramente programmati al computer), sono necessarie ulteriori ricerche sulla correlazione tra il comportamento virtuale e quello di persona, perché, nella misura in cui tale comportamento potrebbe prevenire l’abuso di persona, potrebbe esserci un argomento a favore della sua permissibilità, e viceversa.

Che cosa significa questo per il metaverso?

La tecnologia VR continua a svilupparsi a velocità sempre più sostenuta con l’investimento di ingenti somme di denaro. Solo nel 2021, Meta ha speso per il metaverso 10 miliardi di dollari, e si prevede che le dimensioni del mercato del metaverso raggiungeranno 1.607,12 miliardi di dollari entro il 2030.2424Precedence Research, Metaverse Market Size to Worth around USD 1,607.12 Bn by 2030, GlobeNewswire News Room, 8 giugno 2022.

È dunque molto probabile che il metaverso diventi presto un ulteriore strumento di comunicazione a nostra disposizione. Essendo tuttavia ancora in fase di realizzazione, abbiamo forse ancora qualche piccola opportunità per plasmare ciò che diventerà. Accettando sin da ora che i crimini possano essere commessi all’interno del metaverso, possiamo cominciare a costruire garanzie per proteggere le vittime predisponendo un ambiente sicuro, soprattutto per gli utenti più giovani e vulnerabili.

Scudi di sicurezza

Un esempio del modo in cui ciò può essere realizzato viene da QuiVR, la piattaforma su cui Jordan Belamire è stata maltrattata. In risposta al suo blogpost, gli sviluppatori hanno infatti deciso di costruire uno scudo di sicurezza migliore:

«Vorremmo quindi proporre alla comunità degli sviluppatori di VR un possibile modo di pensare da prendere in considerazione durante la nostra crescita. Si compone di due parti. In primo luogo, dovremmo sforzarci di evitare che le molestie si verifichino, ovviamente. Ma in secondo luogo, quando le molestie si verificano – e non vedo un modo per evitarle del tutto finché esisteranno esperienze multigiocatore – dobbiamo anche offrire gli strumenti per ridare potere al giocatore nel momento in cui si verificano. Non so se abbiamo ragione in questa convinzione, ma ci sembra ragionevole – se la VR ha la capacità di privare qualcuno del potere, e questa sensazione può avere un reale danno psicologico, allora è anche nella nostra capacità di contribuire a mitigare questo fenomeno, restituendo in modo drammatico e dimostrabile il potere al giocatore prima che l’esperienza si concluda».2525«So, we would like to float a possible way of thinking for the VR development community to consider as we grow. It consists of two parts. One, that we should strive to prevent harassment from happening in the first place, of course. But second, when harassment does happen – and I see no way to prevent it entirely so long as multiplayer experiences exist – we need to also offer the tools to re-empower the player as it happens. // I don’t know if we are right in this belief, but it seems a reasonable one to us – if VR has the ability to deprive someone of power, and that feeling can have real psychological harm, then it is also in our ability to help mitigate that by dramatically and demonstrably giving that power back to the player before the experience comes to an end», Henry Jackson et al., Harassment & Superpowers: Dealing with Harassment in VR, UploadVR, 18 agosto 2020.

QuiVR ha introdotto per gli utenti un segnale (una V con le braccia) in grado di attivare una bolla protettiva ed eliminare i giocatori molesti dall’ambiente circostante. Gli effetti visivi sono tipicamente localizzati all’utente, il che significa che se ci troviamo accanto a qualcuno che ha attivato lo scudo, quest’ultimo scompare dal nostro campo visivo (e noi dal suo), pur potendo continuare a giocare.

Segnali come questo dovrebbero essere standardizzati in tutte le esperienze VR, su tutte le piattaforme, così come sono standardizzati i numeri di polizia e di emergenza. Queste protezioni non hanno lo scopo di limitare le capacità di un utente, ma di garantire che ogni partecipante all’esperienza VR si senta sempre al sicuro e acconsenta a ciò che accade intorno a lui.

Dobbiamo sempre ricordare che la VR si differenzia dalla realtà fisica per un aspetto importante: la fisicità non ha alcun ruolo nell’esperienza. Tutti i pixel hanno lo stesso peso e la stessa forza. Ciò, per esempio per le donne, può essere estremamente rassicurante. Se cammino per strada, non è detto che sia in grado di impedire una molestia o un’aggressione, ma sono fortemente limitata dalla mia forza rispetto a quella del mio aggressore. Nella VR, invece, posso e devo avere a disposizione strumenti che equiparino la mia forza e la mia posizione a quelle di tutti gli altri utenti.

Impostazione di un account

Un altro aspetto che necessita di modifiche significative è il processo di creazione di un account. Se ho 27 anni, dovrei forse avere la possibilità di creare un avatar di 9 anni? Se ho 9 anni, dovrei poter essere ammessa nel metaverso?

Come ha dimostrato l’inchiesta di «Channel 4», per accedere alle esperienze VR con le cuffie Oculus Quest è necessario avere un account su Facebook (per cui l’età minima richiesta è di 13 anni). Tuttavia, creare un account fake su Facebook è alquanto semplice, dal momento che i controlli sull’identità degli utenti sono piuttosto blandi. Non solo, ma quando si accede a esperienze VR adatte a bambini di 7 anni, si è comunque esposti al rischio di venire a contatto con contenuti e immagini sessualmente espliciti.

Dall’altra parte, si riscontrano tuttavia svantaggi a favorire requisiti di verifica dell’età e dell’identità più stringenti (per dimostrare chi sta realmente creando l’account): alcune persone potrebbero infatti aver bisogno di proteggere la propria identità (informatori, vittime di abusi domestici, membri perseguitati della comunità LGBTQ+ ecc.). Per loro, il metaverso potrebbe essere l’unico spazio in cui comunicare liberamente e potenzialmente cercare aiuto, senza mettere a rischio la propria privacy.

Segnalazione degli utenti

Un’altra componente fondamentale per rendere il metaverso sicuro e piacevole per tutti i partecipanti è garantire che gli utenti possano essere segnalati quando abusano di altri. Spesso, tuttavia, gli utenti predatori utilizzano di proposito caratteri e testi difficili da vedere e ricordare, in modo da diminuire la possibilità che qualcuno li denunci. Meta ha inoltre confermato che, a meno che gli utenti non stiano usando dispositivi Oculus, non ha modo di rintracciarli. Ciò significa che gli autori dei reati sono in pratica liberi di agire senza alcuna conseguenza. E se pure venissero denunciati, quali sarebbero le conseguenze? La piattaforma VR in questione potrebbe avviare un’indagine ma, per proteggere la privacy degli altri utenti, può comunque spingersi fino a un certo punto: il colpevole sarà bandito? L’utente si chiederà se siano stati o meno presi provvedimenti e questo potrebbe indurlo ad abbandonare del tutto la piattaforma VR.

Esternalizzazione della responsabilità

Horizon, Sandbox, Apple-verse (o qualunque sarà il nome) sono progettati e sviluppati da aziende. Forniscono strumenti ad altri developers per creare esperienze VR a cui accedere attraverso le loro piattaforme (un po’ come l’App Store di Apple, con applicazioni sviluppate da Apple stessa e da sviluppatori terzi). Nell’affrontare le questioni relative alla sicurezza, Meta utilizza frasi di circostanza che abbiamo sentito più volte in relazione ai social network: gli utenti accettano di essere vincolati dai nostri termini e condizioni; prendiamo molto seriamente la sicurezza dei nostri utenti, per questo abbiamo introdotto meccanismi di segnalazione per gli utenti per segnalare comportamenti scorretti; abbiamo sviluppato strumenti di moderazione dei contenuti con l’aiuto della IA; ci affidiamo al feedback degli utenti per migliorare la nostra sicurezza…

Ora, queste frasi sono problematiche a diversi livelli: in primo luogo, attribuiscono agli utenti l’onere di segnalare comportamenti scorretti, nonostante l’azienda disponga di risorse pressoché illimitate per farlo. In secondo luogo, fanno riferimento ai “termini e condizioni” della piattaforma, che tuttavia sono spesso alquanto vaghi e differiscono da una piattaforma all’altra. Infine, l’effettiva applicazione dei termini è notoriamente pessima. Su Facebook, per esempio, un moderatore di contenuti IA potrebbe non riconoscere le sfumature di un post potenzialmente dannoso o illegale secondo i termini di Facebook stesso. Nel metaverso la moderazione dei contenuti sarà ancora più complessa: a meno che gli utenti non registrino un segmento della loro esperienza, le interazioni saranno in tempo reale e non verranno memorizzate da nessuna parte.

Dunque, come possiamo gestire la responsabilità degli utenti e l’applicazione di leggi e norme nel metaverso? Come abbiamo appreso dalle udienze di Facebook, non possiamo aspettare che le aziende che operano in quasi-monopoli nei mondi virtuali elaborino regolamenti e meccanismi di applicazione adeguati. Non investono infatti abbastanza denaro e si preoccupano principalmente di incrementare la propria quota di mercato per abbattere le concorrenti. Il loro obiettivo è di lanciare il più rapidamente possibile le nuove tecnologie, senza per forza garantire l’effettivo rispetto delle linee guida della comunità. Il governo e le autorità di regolamentazione devono quindi avere i propri strumenti di applicazione, per proteggere gli utenti e garantire che le azioni dei perpetratori abbiano precise conseguenze. La regolamentazione dovrà inevitabilmente tenere conto di due aspetti fondamentali: (i) l’anonimato degli utenti può avere un certo valore e (ii) la portata giurisdizionale.

Il Regno Unito si appresta a introdurre una legge sulla sicurezza online, prima al mondo, con l’obiettivo di diventare la «nazione più sicura per i bambini online». Ma, come si legge nella scheda informativa,2626Online Safety Bill: Factsheet, GOV.UK.

non si tratta di un compito facile (e infatti, dopo molteplici emendamenti, il disegno di legge è stato ripresentato il 5 dicembre 2022 per una terza lettura alla House of Commons).2727Online Safety Bill – Parliamentary Bills – UK Parliament, UK Parliament, 5 dicembre 2022.

Per quanto riguarda l’anonimato, come discusso in precedenza nel contesto della creazione di un account, dobbiamo bilanciare gli interessi contrastanti di coloro che richiedono legittimamente la non divulgazione della propria identità e di coloro che usano l’anonimato per predare le vittime. Un aspetto che potrebbe allontanare il metaverso dall’anonimato – se Tumblr è un esempio – è la pubblicità. Nike e altre aziende hanno già annunciato (e lanciato) piani per esperienze di shopping nel metaverso. Ma per far sì che gli utenti sappiano quale scarpa comprare, è necessario che siano targettizzati. Inoltre, per acquistare il prodotto, gli utenti hanno bisogno di un conto bancario (o, se il metaverso accetta le criptovalute, di un portafoglio di criptovalute).

Il secondo aspetto chiave è la giurisdizione. Supponendo che ai governi e alle autorità di regolamentazione siano concessi i poteri per far pagare i crimini che avvengono nel metaverso, come faremo a stabilire a quale ordinamento giuridico si dovrà fare riferimento? Supponiamo infatti, per esempio, di utilizzare Horizon a Londra e di avviare con un’amica che si trova fisicamente in Francia una conversazione che negli Stati Uniti verrebbe classificata come “discorso d’odio”. In questo caso staremmo effettivamente commettendo un reato, essendo Meta un’azienda con sede negli Stati Uniti? Non staremmo invece commettendo un reato, trovandoci io e la mia amica in due Paesi in cui la legge statunitense non si applica? Oppure, non lo staremmo commettendo perché magari i termini e le condizioni di Meta non lo classificano come discorso d’odio?

Se non vogliamo che le aziende decidano in base ai propri termini e condizioni, dobbiamo affrontare il fatto che non tutte le giurisdizioni hanno a cuore gli stessi valori. Se vivo in un Paese in cui l’omosessualità è un crimine, punibile con la morte, un altro utente potrebbe denunciare i miei atti nel metaverso come violazione della legge.

Recentemente, il Ministro dell’IA dell’Arabia Saudita, Al Olama, è intervenuto a Davos, sostenendo che l’agenzia specializzata delle Nazioni Unite per le tecnologie dell’informazione e della comunicazione dovrebbe prendere in considerazione la possibilità di stabilire degli standard di sicurezza internazionali per il metaverso, da rispettare indipendentemente dal luogo in cui si trova l’utente.2828Sam Shead, Serious Crime in the Metaverse Should Be Outlawed by the U.N., UAE Minister Says, «CNBC», 25 maggio 2022.

Ma anche se, nell’era di Splinternet, riuscissimo a creare degli standard universali, concederemmo alle Nazioni Unite il potere di farli rispettare nel cyberspazio? Mi sembra un’ipotesi perlomeno velleitaria.

Sebbene non abbia risposte definitive su come dovremmo regolamentare il metaverso, dobbiamo continuare a condurre ricerche sulla correlazione tra il comportamento online (compreso quello che coinvolge avatar puramente programmati al computer) e il nostro comportamento di persona. Dobbiamo inoltre ritenere le aziende responsabili dei prodotti che vendono. Se gli utenti subiscono abusi almeno una volta ogni 7 minuti per un periodo di 12 ore2929Tom Lavelle, Facebook’s Metaverse, Center for Countering Digital Hate, CCDH, 13 maggio 2022.

e se le loro funzioni di scudo di sicurezza non sono ancora funzionanti o pienamente sviluppate, perché le piattaforme sono comunque disponibili in commercio? Perché non sono stati condotti altri beta-test per garantire che la comunità sia un rifugio sicuro per tutti, e non solo per i troll che spargono odio?

More on Magazine & Editions

Magazine , ESCAPISMI - Part I

Rifugiarsi nel sogno per rompere il sonno. Pratiche per cadere dalla ruota del criceto

Un saggio, un’altra meta-narrazione della realtà che contribuirà a resistere alla noia, di chi scrive sicuramente e forse anche di chi legge; a rompere il sonno e a credere nei sogni come forma di potere.

Magazine , LINGUAGGI - Part II

Fine dei motivi e dei generi cinematografici

Il cinema tra realtà e distopia: le tecnologie per la sorveglianza di massa nei film di fantascienza e le riflessioni di Harun Farocki sulle trasformazioni dei linguaggi cinematografici

Editions

Estrogeni Open Source

Dalle biomolecole alla biopolitica… Il biopotere istituzionalizzato degli ormoni!

Editions

Hypernature. Tecnoetica e tecnoutopie dal presente

Dinosauri riportati in vita, nanorobot in grado di ripristinare interi ecosistemi, esseri umani geneticamente potenziati. Ma anche intelligenze artificiali ispirate alle piante, sofisticati sistemi...

More on Digital Library & Projects

Digital Library

È pensato per fare schifo: l’estetica dell’“Internet Ugly”

Nick Douglas analizza il codice memetico di Internet tra viralità, appropriazionismo e tendenze revivalistiche.

Digital Library

Superdiversità su Internet: un caso dalla Cina

MC Liangliang e il super-vernacolare globale dell’hip hop di Internet.

Projects

Antropologia del mondo virtuale: Jon Rafman in conversazione con Diana Baldon

La registrazione della conversazione tra l’artista Jon Rafman e Diana Baldon, direttrice di Fondazione Modena Arti Visive, in occasione della personale realizzata da Fondazione Modena Arti Visive.

Projects

Il sapere infinito: informazione e produzione culturale tra digitale e cartaceo (#artissimalive)

Ugo Bertone, Federico Ferrazza, Federico Sarica e Jacopo Tondelli, con la moderazione di Elena Masuelli, ci raccontano le relazioni tra il sistema di produzione cartacea e quello digitale.

Iscriviti alla Newsletter

"Information is power. But like all power, there are those who want to keep it for themselves. But sharing isn’t immoral – it’s a moral imperative” (Aaron Swartz)

-

Giulia Trojano lavora per lo studio legale internazionale Withers come associata nel contenzioso commerciale e nell'arbitrato, con un'affinità per il diritto dell'arte. Attualmente risiede a Londra. È particolarmente interessata a far progredire il discorso giuridico e politico attraverso un attento studio delle forme d'arte contemporanea e sperimentale. Giulia si è laureata alla LSE con un LLB in Giurisprudenza e prima ancora ha vissuto a Roma e Vienna.

Ashcroft v. Free Speech Coalition, Encyclopædia Britannica.

Yinka Bokinni, Inside the Metaverse: Are You Safe? Dispatches, «Channel 4», 25 aprile 2022.

Rita Carter, Multiplicity: The new science of personality, identity, and the self, Little, Brown & Company, 2008.

David J. Chalmers, Reality+: Virtual Worlds and the Problems of Philosophy, Penguin Books, London, 2022.

Gene Demby, How Code-Switching Explains the World, «NPR», 8 aprile 2013.

Adriana Diaz, Disturbing Reports of Sexual Assaults in the Metaverse: “It’s a Free Show”, «New York Post», 27 maggio 2022.

Bernhard Drax, Our Digital Selves: My Avatar Is Me!, 18 maggio 2018.

Ashley Hoffman, Dolly Parton Challenge Inspires Multiple Personality Memes, «Time», 29 gennaio 2020.

Elle Hunt, Tay, Microsoft’s AI Chatbot, Gets a Crash Course in Racism from Twitter, «The Guardian», 24 marzo 2016.

Henry Jackson et al., Harassment & Superpowers: Dealing with Harassment in VR, UploadVR, 18 agosto 2020.

Tom Lavelle, Facebook’s Metaverse, Center for Countering Digital Hate, CCDH, 13 maggio 2022.

David Lester, A Multiple Self Theory of the Mind, «Comprehensive Psychology», gennaio 2012.

Courtney L. McCluney et al., The Costs of Code-Switching, «Harvard Business Review», 15 novembre 2019.

Jennimai Nguyen, Tumblr Died a Slow and Painful Death. Here’s How TikTok Can Avoid the Same Fate, «Mashable», 29 ottobre 2021.

Nina Jane Patel, Fiction vs. Non-Fiction, Medium, Kabuni, 4 febbraio 2022.

Precedence Research, Metaverse Market Size to Worth around USD 1,607.12 Bn by 2030, GlobeNewswire News Room, 8 giugno 2022.

Sam Shead, Mark Zuckerberg Says a New Skin-like Material Could Support Metaverse Ambitions, CNBC, 1 novembre, 2021.

Sam Shead, Serious Crime in the Metaverse Should Be Outlawed by the U.N., UAE Minister Says, «CNBC», 25 maggio 2022.

Olivia Solon, Mark Zuckerberg “Tours” Flooded Puerto Rico in Bizarre Virtual Reality Promo, «The Guardian», 10 ottobre 2017.

Jessica Wolfendale, My Avatar, My Self: Virtual Harm and Attachment, «Ethics and Information Technology», 9, 2007.

KABUL è una rivista di arti e culture contemporanee (KABUL magazine), una casa editrice indipendente (KABUL editions), un archivio digitale gratuito di traduzioni (KABUL digital library), un’associazione culturale no profit (KABUL projects). KABUL opera dal 2016 per la promozione della cultura contemporanea in Italia. Insieme a critici, docenti universitari e operatori del settore, si occupa di divulgare argomenti e ricerche centrali nell’attuale dibattito artistico e culturale internazionale.